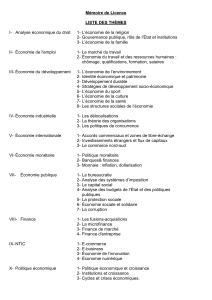

Etude de dossier

ÉTUDE DE DOSSIER

______

Adjoint de direction 2012

Concours externe et interne

La finance est devenue ultra mathématisée à partir des années 70. La récente crise financière a

suscité des interrogations sur le rôle des mathématiques et en particulier des modèles

mathématiques en finance.

À partir des documents joints, dans le contexte de la crise financière, vous rédigerez une note sur

l’utilisation des modèles mathématiques et ses conséquences.

LISTE DES DOCUMENTS JOINTS

1. « Où se trouve le risque ? »

Christian WALTER - Banque Stratégie n° 297 - Novembre 2011 - 2 pages

2. « De la théorie à la pratique - Est-il vraiment important que les marchés soient efficients ? »

Alfred GALICHON et Philippe TIBI - Revue Banque hors série - Mai 2011 - 7 pages

3. « Les dix péchés capitaux de la Value at Risk »

Philippe FOULQUIER et Alexandre LE MAISTRE - Banque Stratégie n° 303 - Mai 2012

5 pages

4. « The Case Against The modern Theory of Finance »

Benoît MANDELBROT - The (mis) Behaviour of markets – 2008 - Chapitre V - 4 pages

5. « Les modèles contribuent-ils à l’efficacité des marchés financiers ? »

Nizar TOUZI et Philippe DURAND - Revue Banque hors série - Mai 2011- 5 pages

6. « Est-ce la faute des « petits génies » en mathématiques ? »

Nicole CRESPELLE - La crise en questions - Éditions Eyrolles - 2009 - 1 page

7. « Une dangereuse sous-estimation de l’incertitude »

Philippe HERLIN - Alternatives Économiques hors série n° 87 - 1er trimestre 2011 - 3 pages

8. « Mathématiques et risques financiers »

Nicolas BOULEAU - Éditions Odile Jacob - 2009 - 1 page

9. « Les mathématiques financières et la crise financière »

Nicole EL KAROUI et Monique JEANBLANC- Matapli - Bulletin de liaison - Vol. 87

2008 - 6 pages

10. « Benoît Mandelbrot et la modélisation mathématique des risques financiers »

Rama CONT - http://hal.inria.fr - 19/01/2012 - 6 pages

1

AD 2012 1/2 Banque stratégie n° 297

Novembre 2011

MODÈLES MATHÉMATIQUES

OÙ SE TROUVE LE RISQUE ?

La gestion alternative est-elle plus ou moins risquée que la gestion traditionnelle ?

Tout dépend des modèles mathématiques utilisés...

[…]

COMMENT MESURER LE RISQUE ?

Nous avons montré dans un article publié en 20051 comment l'idée de l'indexation et des benchmarks a

représenté dans la finance du XXe siècle la résurgence de la théorie de l'homme moyen du statisticien

et astronome belge Adolphe Quetelet. La résistance à l'indexation et au bornage systématique des

gestions représente la forme contemporaine des débats qui ont agité les statisticiens à la suite de la

domination de la théorie des moyennes dans les années 1860. La gestion « autre » que la gestion

bornée retrouve les arguments utilisés par les adversaires de la quételéisation massive de la statistique

au XIXe siècle : la moyenne (la performance du benchmark) ne peut représenter un critère qui résume

suffisamment le comportement réel des portefeuilles. Et la volatilité -qui n'est qu'un écart moyen à la

moyenne- relève du même dogme quételésien. La Value-at-Risk, lorsqu'elle se contente de transformer

une volatilité en quantiles, ne répond en rien au problème de la gestion du risque. Loin des moyennes.

L'idée sous-jacente à la catégorisation en classe spécifique de la gestion « autre » est celle de la

protection de l'épargnant (de l'investisseur) contre des risques mal cernés. Mais les risques sont-ils

moindres dans le cas de gestions bornées ? La diversification représente-t-elle une forme de gestion

moins risquée que celles que l'on trouve dans les gestions qualifiées d'« alternatives » ? Il est

couramment admis aujourd'hui qu'une gestion bien diversifiée et bornée est davantage protectrice pour

l'épargne qu'une gestion « alternative ». Or rien n'est moins sûr : ce raisonnement nécessite la

validation d'une hypothèse mathématique relative aux probabilités. Et il est connu aujourd'hui que

cette hypothèse est mise en défaut dans beaucoup de situations de marchés. Dans ces contextes, la

gestion non diversifiée (donc « autre » que la gestion classique) est plus protectrice et les portefeuilles

concentrés traversent mieux les crises que les portefeuilles diversifiés. En fait, croire que la

diversification protège bien revient à croire que les fluctuations boursières sont très régulières et bien

homogènes, que la performance des portefeuilles se répartit équitablement sur tous les titres du

portefeuille, toutes les journées de Bourse. Mais tous les professionnels observent bien que la

performance (et les pertes) se concentre sur quelques titres bien ou mal choisis, sur quelques journées

particulières de Bourse, que le marché est souvent calme (sauf quand il est très agité), et que la vraie

loi des portefeuilles gérés et bien plutôt une loi des 80/20 : très peu de titres (de jours) contribuent à

beaucoup de gains ou de pertes.

L'IMPACT DE LA DIVERSIFICATION

Dans un travail récent2 réalisé avec Olivier Le Courtois, nous avons montré comment une gestion peu

diversifiée, qui suivrait des règles qualifiées d'« alternatives » au sens franglais, pourrait être plus

protectrice qu'une gestion « classique » bien diversifiée. En remplaçant les modèles mathématiques à

base de mouvements browniens par d'autres modèles utilisant des processus aléatoires non browniens,

c'est-à-dire en changeant les hypothèses probabilistes sur les fluctuations boursières, l'indexation et la

1 « La gestion indicielle et la théorie des moyennes », Revue d'économie financière, n° 79, pp. 113-136.

2 « La concentration des portefeuilles ». Perspective générale et illustration, Cahiers de recherche de l'EM Lyon, 2008/03.

1

AD 2012 2/2 Banque stratégie n° 297

Novembre 2011

gestion bornée apparaissent tout à coup bien plus dangereuses que la gestion « alternative ». Derrière

ces débats, ce qui est en jeu est une compréhension de l'incertitude financière.

L'objectif est simple : le régulateur cherche à protéger l'investisseur. Pour cela, il lui faut indiquer des

catégories de risque, et donc apprécier l'incertitude financière représentée par les produits vendus.

Pour cela, il est nécessaire de disposer de mesures et donc de modèles de cette incertitude financière.

Le choix est alors le suivant : soit on considère que l'incertitude est modélisable par un aléa régulier

(par exemple un modèle probabiliste qui utilise le mouvement brownien3) et, dans ce cas, les mesures

usuelles du risque suffisent et permettent d’isoler une pseudo-catégorie appelée en franglais « gestion

alternative », décrite comme plus risquée en regard de l’hypothèse de régularité aléatoire ; soit on

considère que la représentation brownienne est trompeuse, et il devient alors nécessaire de repenser les

manières d’apprécier le risque des produits financiers, qui peuvent remettre en cause la partition

risqué/non risqué qui repose sur la vision brownienne lisse du risque. Dans ce cas, il est bien possible

que les gestions dites « alternatives » se révèlent moins risquées que les gestions benchmarkées.

Par analogie avec la manière dont une maladie se répand, en employant le modèle de la contagion des

idées, nous avons appelé en 2009 « virus B » (pour « virus brownien »), l’épidémie intellectuelle qui a

fait penser l’incertitude au moyen d’une représentation brownienne des fluctuations (Le virus B. Crise

financière et mathématique, éditions du Seuil). Dans la gestion d’actifs, il semble bien que le virus

brownien ait muté et soit devenu le virus des benchmarks. Un autre B…

Christian WALTER

Christian WALTER est actuaire agrégé (Institut des actuaires), professeur associé (IAE, Université Paris I) et titulaire de la

chaire Éthique et Finance (Institut catholique de Paris).

3 En 1827, le botaniste écossais Robert Brown observe au microscope les grains de pollen de la plante Clarckia pulchella. Il constate que ces

grains contiennent des particules et que ces particules, dans l'eau, sont animées de mouvements continuels (dus à l'agitation thermique).

Les particules se déplacent dans tous les sens, apparemment au gré du hasard. Ce hasard obéit à des règles précises qui décrivent le

mouvement désordonné de ces particules : c'est le mouvement de Brown, ou mouvement brownien. Les règles de ce mouvement seront

définies mathématiquement au début du XXe siècle par Louis Bachelier (1900), Albert Einstein (1905), et Norbert Wiener (1923). La « loi

en racine carrée du temps » qui fait transformer la volatilité mensuelle en volatilité annuelle (12 mois) en multipliant la première par la

racine carrée de 12, et que l'on trouve dans les réglementations prudentielles internationales (comme Bâle III pour les banques ou

Solvabilité 2 pour les compagnies d'assurance) est une application de l'hypothèse brownienne.

2

AD 2012 1/7 Revue Banque hors série

Mai 2011

DE LA THÉORIE À LA PRATIQUE

EST-IL VRAIMENT IMPORTANT QUE LES

MARCHÉS SOIENT EFFICIENTS ?

L'efficience des marchés, qui n'était au début qu'une hypothèse émise par Eugene Fama, s'est

affirmée au fil des années comme une théorie sur laquelle se fonde la finance moderne. La crise

de 2008 l'a profondément remise en cause... ce qui n'a pas empêché les marchés, durant la crise,

de remplir leurs fonctions essentielles : financer l'économie et assurer l'épargne des investisseurs

finaux. Quelle importance, alors, accorder à cette théorie ?

'eff

thé

que

peut tradu

icience des marchés est une question

orique majeure dont la validité a été

stionnée par la crise de 2007. On

ire l'expression anglaise « efficient

markets » par « marchés efficients » ou

« marchés efficaces ». Or, la distinction entre

ces deux traductions ne relève pas uniquement

de la nuance sémantique ou de la chasse aux

anglicismes. Le terme « efficient » employé au

plus près du sens de l'expression anglaise

suppose un marché :

rationnel ;

incorporant toute l'information dispo-

nible ;

impossible à battre.

« Efficient » ne signifie pas la même chose

qu'« efficace », qui évoque un marché en état

de marche, apportant des solutions, résolvant

rapidement des problèmes -et dont la traduction

anglaise serait « operational »-).

Aussi dogmatique que certains puissent

la considérer aujourd'hui, la théorie

de l'efficience des marchés fut initialement

formulée comme une hypothèse : 1'« efficient

market hypothesis » (EMH). Celle-ci est

particulièrement importante dans la

construction de la finance moderne car, d'une

part, elle a joué un rôle structurant dans le

développement du secteur financier des trente

dernières années et, d'autre part, tous les acteurs

des marchés financiers l'intègrent dans leurs

outils de prise de décision. Si les marchés ne

sont pas efficients, faut-il remettre en

question les conséquences scientifiques et

politico-économiques tirées de la théorie ?

D'un point de vue scientifique d'abord,

L'EMH est en effet l'une des pierres de touche

d'une industrie financière dont l'utilité

économique et sociale est de financer

l’économie et de gérer l'épargne (et donc

individus. Si l'EMH n'est pas valide, la science

économique ne doit-elle pas, comme elle l'a fait

dans les précédentes crises majeures, remettre

en cause ses fondements théoriques et explorer

de nouvelles voies ?

D'un point de vue p

d'assurer certains risques sociaux) des

olitique, l'EMH fait partie

du faisceau d'arguments qui justifient le laissez-

faire économique: si les prix des actifs sont de

« bons » prix, si la « main invisible » fait son

office et alloue les ressources de façon

optimale, alors la vocation de l'État n'est pas de

jouer un rôle par construction inutile, voire

nuisible, d'encadrement de l'économie, par les

règles, les incitations et les prix. Ceci suppose

que les marchés « efficients » sont « efficaces »

pour allouer les ressources. Pour prendre une

analogie osée avec la physique, une théorie

« juste » est en général « efficace ». La rela-

tivité générale, qui n'a pas été invalidée durant

près d'un siècle et peut donc être considérée

comme « juste » jusqu'à preuve du contraire, est

« efficace » car elle permet d'écrire justement

les équations qui assurent le bon

fonctionnement de certains systèmes, pour

lesquels la mécanique newtonienne ne suffit

pas, comme les GPS, par exemple. Les deux

notions ne se superposent pourtant pas tout à

fait. Pour continuer l'analogie avec la physique,

une théorie imparfaite, voire inexacte, peut

donner des résultats parfaitement acceptables

pour l'utilisation qu'on en fait : c'est le cas de la

mécanique newtonienne, dépassée par la

physique quantique, mais qui suffit parfai-

tement à de nombreuses applications pratiques,

pour lesquelles elle est « efficace ». Ainsi, sans

être forcément « efficients », les marchés

pourraient être « efficaces » au regard de leur

fonction sociétale. L'objectif de cet article est

d'éclairer ces deux notions et de poser les

termes objectifs d'un débat miné par ses

L

2

AD 2012 2/7 Revue Banque hors série

Mai 2011

connotations idéologiques, et dont la crise née

en 2007 souligne encore l'actualité.

I. LE DÉBAT

UNE ÉTAPE CLEF DANS LA GÉNÉALOGIE DE

LA FINANCE MODERNE

La théorie des marchés efficients a été

formulée, sous forme d'une « hypothèse », pour

la première fois en 1970 par Eugene Fama de

l'Université de Chicago. Selon cette théorie,

toute information est reflétée dans le prix d'un

actif, qui n'est autre que la somme actualisée

des cash flows attendus. La meilleure prédiction

qu'on puisse faire à propos du prix futur d'un

actif est son prix de marché présent : il n'y a

pas d'« opportunités d'arbitrage ». Toutefois, les

interprétations de la notion fluctuent. Dans

une conférence datant de 1984, James Tobin1

distingue quatre formes possibles d'efficience

des marchés : d'une notion purement technique

(arbitrage efficiency : il n'y a pas d'opportunités

d'arbitrage) à une notion d'économie politique

(functional efficiency : les marchés remplissent

efficacement certains rôles pour les individus,

c'est cette notion que nous traduisons ici

par « efficacité »), en passant par deux notions

intermédiaires : fundamental valuation effi-

ciency, qui signifie que les prix de marché sont

justes, et full valuation efficiency, qui signifie

que les marchés sont complets (c'est-à-dire qu'il

est possible de s'assurer contre tous les risques).

L'EMH joue un rôle très particulier dans la

généalogie de la finance moderne. La boîte à

outils des financiers contemporains (directeurs

financiers, analystes, investisseurs) a été consti-

tuée à partir de ses fondements intellectuels,

qui, pour citer John Cochrane2, ont transformé

la finance « d'une collection d'anecdotes en

science ». On peut ainsi citer parmi la

descendance de l'EMH et du modèle CAPM la

gestion indicielle, la valorisation des options, la

théorie des stock-options, etc.

UNE HYPOTHÈSE DEVENUE DOMINANTE

Jusqu'à ces dernières années, l'EMH semblait

d'une robustesse considérable, tant théori-

quement qu'empiriquement.

1 James Tobin, « On the Efficiency of the Financial System »,

Lloyds Bank Review, 1984.

2 John Cochrane, « Efficient market today », Conference on

Chicago Economics, 10 novembre 2007.

Théoriquement tout d'abord, car accepter que

l'EMH était invalide revenait à supposer les

investisseurs non rationnels, ce que les

économistes en général répugnent à faire, sauf

pour une minorité d'entre eux qui pratiquent

l'économie dite « comportementale ». Et empi-

riquement, car de nombreux travaux éco-

nométriques la valident. Ainsi, Michael Jensen

écrivait en 1978 dans une introduction à un

numéro du Joumal of Financial Economics3

entièrement consacré à la validation empirique

de cette hypothèse, que « peu de propositions

en économie ont des fondements empiriques

plus solides que l’hypothèse de l’efficience des

marchés ». Les circonstances de la dernière

crise de marché allaient cependant remettre en

question les prémisses de la théorie.

APRÈS LA CRISE DE 2008, UN DÉBAT

VIGOUREUX…

Dans un article célèbre4, Krugman impute à la

finance « moderne » une responsabilité dans la

crise de 2008. Selon lui -la popularité de ce

point de vue ayant cru fortement au cours

des deux dernières années-, les économistes

« mainstream » majoritaires n'ont rien vu venir

car ils ont été désarmés par leur croyance dans

l'EMH, les théories mathématiques élégantes

qu'elle a permis de formuler, et aussi par un

confort intellectuel et matériel qui les a fait

épouser les intérêts des puissances financières.

La confiance excessive des économistes en

leurs outils et en leurs modèles les a conduits à

penser que les chocs macroéconomiques et

financiers (et les récessions au premier chef)

pouvaient être maîtrisés. Ainsi, la croyance en

l'avènement d'une ère de la « grande modé-

ration » qui serait marquée par la maîtrise

durable de la volatilité est caractéristique de

cette attitude, et comparable à certains égards à

la croyance en la « fin de l'histoire ».

Mais le camp adverse n'est pas excessivement

troublé par la crise. Ainsi, pour Eugene Fama,

la crise provient au contraire de ce que l'EMH

n'a pas été prise suffisamment au sérieux : « If

banks and investment banks took market

efficiency more seriously, they might have

avoided lots of their recent problems5 ».

3 Michael Jensen, « Some Anomalous Evidence Regarding

Market Efficiency », Journal of Financial Economics, Vol.6,

n° 2/3, 1978.

4 Paul Krugman, « How Did Economists Get It So Wrong ? »,

New York Times, 6 septembre 2009.

5 Q & A, « Is Market Efficiency the Culprit ? », Fama/French

Forum, 4 novembre 2009.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

41

41

1

/

41

100%