Outils pour la modélisation stochastique

(Ω,A,IP) Ω A

Ω

IP

(Ω,A) (IR,B)

BIR f

fIR B A

X

IR Ω IR IP0

IIR IP0(I) = IP(X−1(I)) = IP{ω;X(ω)∈I}

X Y

A B IR

P(X∈A Y ∈B) = P(X∈A)P(Y∈B).

(X, Y ) = IE(XY )−IE(X)IE(Y).

•

•

•

X= (X1, . . . , Xp)XΣ

(Xi, Xj)i j p (a1, . . . , ap)

(b1, . . . , bp)

(a1X1+ +apXp, b1X1+··· +bpXp) = (a1, . . . , ap)Σ t(b1, . . . , bp).

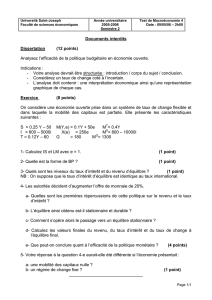

P Y =P X Y

PΣtP

IR IR

IR

IR

IR

IR

N(µ, σ2)

IR

f(x) = 1

√2πσ exp −(x−µ)2

2σ2

µ∈IR σ > 0

Z+∞

−∞

xpf(x)dx < +∞,

p∈IN p σ2

P(θ)

IN

IP(X=k) = exp(−θ)θk

k!

θ > 0

∞

X

k=0

kpP(X=k)<∞.

θ

X1X2

a aX1

X1X2

a aX1

n(X1, ....Xn)

σ2SnSn/√nN(0, σ2)

p(X1, . . . , Xp)p

(X1, . . . , Xp)

(a1, . . . , ap)a1X1+··· +apXp

•

•

•

•

•

•

X

ΣP

tP=P−1)DΣ = tP DP Y =tP X Y

D Y

L(X0)X0L(X1|X0)X1X0L(X2|X1, X0)X2

X1X0

n(X0, X1, .., Xn)

IN

E E = 1,2, . . . , k X

IN ×Ω

XnXn−1

IP(Xn=in|Xn−1=in−1, . . . , X0=i0) = IP(Xn=in|Xn−1=in−1).

EIP((Xn=j|Xn−1=i)

i j i j

Pnk×k

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

1

/

16

100%