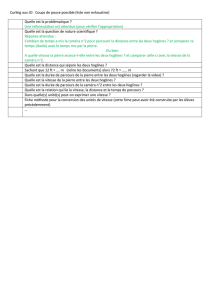

PerAv, ch.1.3b - Laboratoire MIS

UPJV, Département EEA

Master 2 EEAII

Parcours ViRob

Fabio MORBIDI

Laboratoire MIS !

Équipe Perception et Robotique!

Semestre 9, A.U. 2015-2016

Mardi 9h30-12h30 et 15h00-17h30

Salle TP101

2

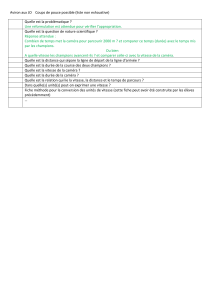

Plan du cours

Chapitre 1: Perception pour la robotique [F. Morbidi]

Chapitre 2: Modélisation d’incertitudes [D. Kachi]

1. Introduction

3. Typologies de capteur

2. Classification des capteurs

1. Introduction

3. Représentation statistique

2. Représentation de l’incertitude

4. Propagation de l’erreur: fusion des mesures de l’incertitude

Chapitre 3: Traitement des mesures [D. Kachi]

1. Réseau multi-capteurs

2. Fusion des mesures

Partie I : Perception Avancée

3

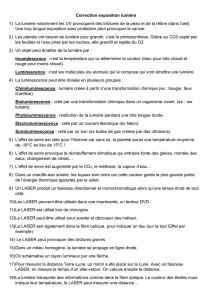

Télémètres laser

LIDAR («Light Detection And Ranging»)

En réalité portmanteau de «light» et «radar»

Rayons émis/reçus coaxiaux

Longueur d’onde: typiquement 780-900 nm

Jamais pure réflexion: toujours de la diffusion sur le cible

Spectre de la lumière visible (390 nm – 750 nm)

Longueur d’onde [nm]

rayon émis

rayon reçu

Diffusion

sur le cible

400 700

500 600 750

650 550

450

LIDAR

4

Télémètres laser

Deux méthodes de mesure:

1. Laser pulsé (ex. SICK)

• Mesure directe du temps de vol

• Besoin d’une mesure à la

picoseconde (10-12 s)

(En fait, 3 m correspondent à 10 ns)

2. Mesure de déphasage (ex. Hokuyo)

• Émission d’onde modulée

à fréquence connue

• Mesure du déphasage entre

les signaux émis et reçus

• Techniquement plus simple

5

Télémètres laser: fonctionnement

SICK

SICK

SICK

Miroir rotatif

Faisceau laser

Obstacle Obstacle

LIDAR LIDAR LIDAR

Obstacle

LIDAR LIDAR LIDAR

Mesures de distance

(bleu) à des intervalles

angulaires réguliers

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

1

/

40

100%