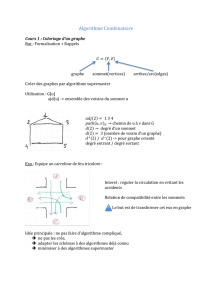

Chapitre 8 : Introduction aux méthodes heuristiques

Graphes et RO – TELECOM Nancy 2A

Chapitre 8 : Introduction aux m´ethodes heuristiques

J.-F. Scheid

1

Plan du chapitre

I. Introduction

II. Quelques m´ethodes heuristiques

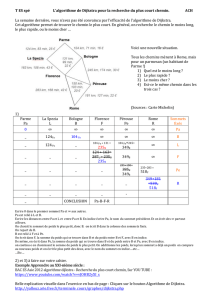

1Algorithme A∗

2Recuit Simul´e

3Algorithmes g´en´etiques

4Algorithme de colonies de fourmis

2

I. Introduction

Pour les probl`emes de grandes tailles :

pas de temps de calculs ”raisonnables” avec les m´ethodes exactes

recherche de ”bonnes” solutions approch´ees.

Heuristiques : r`egles empiriques simples qui ne sont pas bas´ees sur

l’analyse scientifique (6= algorithmes). Elles sont bas´ees sur l’exp´erience et

les r´esultats d´ej`a obtenus et sur l’analogie pour optimiser les recherches

suivantes. G´en´eralement, on n’obtient pas la solution optimale mais une

solution approch´ee.

M´eta-heuristiques : algorithmes d’optimisation (g´en´eralement de type

stochastique) combinant plusieurs approches heuristiques.

3

On a d´ej`a rencontr´e des m´ethodes heuristiques :

initialisation du ”branch-and-bound” pour le probl`eme du sac-`a-dos

(calcul de F)

m´ethode du coin Nord-Ouest pour l’affectation.

Ces exemples font partie d’une classe de m´ethodes appel´ees ”algorithmes

gloutons”.

Algorithme glouton (”greedy”) : construction d’une solution r´ealisable en

se ramenant `a une suite de d´ecisions qu’on prend `a chaque fois au mieux

en fonction d’un crit`ere local sans remettre en question les d´ecisions d´ej`a

prises. G´en´eralement, la solution obtenue est approch´ee.

Int´erˆet : algorithmes simples `a impl´ementer.

D´efaults : solutions approch´ees obtenues plus ou moins bonnes, crit`ere

local (”myopie”).

4

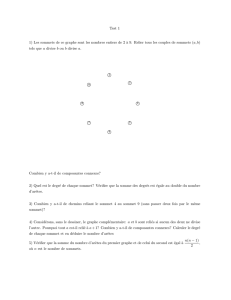

Exemple : Placement optimal de pi`eces 2D (Bin Packing).

On dispose de plaques rectangulaires toutes identiques dans lesquelles on

veut placer des pi`eces rectangulaires sans chevauchement. Les pi`eces `a

placer ont des dimensions diff´erentes.

plaque

pièces

. . .

On veut trouver le placement pour minimiser le nombre de plaques

utilis´ees.

Algorithme glouton :trier les pi`eces en fonction de leur taille et placer

d’abord les pi`eces les plus grandes.

5

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

28

28

29

29

30

30

31

31

32

32

33

33

34

34

35

35

36

36

37

37

38

38

39

39

40

40

1

/

40

100%