Document

Yohan Rimaud - 1 - 17/04/2017

Conférence de méthode d’économie

Séances du second semestre

[ 1 ] Inflation, désinflation

Définitions

Inflation : hausse des prix généralisée cumulative et autoentretenue

Déflation : contraction des grandeurs économiques nominales, tantôt symptôme tantôt cause

d’une récession

Désinflation : ralentissement du niveau d’inflation

Dévaluation : décision d’inscrire légalement le niveau de la monnaie à un niveau plus bas

qu’antérieurement

Inflation importée : inflation due au renchérissement de produits importés

L’inflation positive provoque une dégradation de la compétitivité des prix, ce qui se traduit

par un déficit de la balance commerciale.

Différentes inflations

L’inflation monétaire trouve son origine dans l’émission excessive de monnaie (par exemple

l’afflux de métaux précieux au XVIème siècle, le recours massif à la « planche à billets » avant

et pendant la Première Guerre mondiale).

L’inflation par la demande se situe dans le prolongement de l’explication précédente : le

déséquilibre provient de l’excès de la demande sur l’offre (dont l’inélasticité peut provenir

d’une situation de plein-emploi par exemple).

Enfin l’inflation par les coûts situe l’origine de l’inflation dans un déséquilibre de la

formation des prix au sein de l’entreprise : l’augmentation des coûts, associée à la volonté des

entreprises de maintenir leurs profits, favorise une hausse des prix.

Les approches théoriques de l’inflation

L’économiste mercantiliste Jean BODIN a expliqué en 1568 que l’augmentation des prix en

Europe s’expliquait par l’afflux d’or et d’argent en provenance des Amériques. Cette théorie,

selon laquelle la valeur d’une monnaie est inversement proportionnelle à sa quantité, est

nommée « théorie quantitative de la monnaie » ; elle a été formulée et développée par Irving

FISHER en 1911, pour lequel : M x V = P x T. L’idée est que la monnaie en circulation M et

le prix moyen P sont strictement reliés ; il faut pour cela supposer que la vitesse de circulation

V et le nombre de transactions T sont stables, donc une stabilité des comportements

monétaires et de la croissance du PIB. De plus, pour que T soit stable, il faut que la neutralité

de la monnaie soit complétée par un plein-emploi des facteurs de production (SAY).

Le néoclassique Alfred MARSHALL a mis au point « l’équation de Cambridge » : M = kPY.

La demande de monnaie s’explique ici par le niveau de revenu et les prix.

Milton FRIEDMAN a réhabilité la théorie quantitativiste : la demande de monnaie dépend du

revenu permanent, des anticipations inflationnistes et du patrimoine au sens large.

Dans la conception monétariste de la monnaie (ou néoquantitativiste), la demande de monnaie

est stable (la fonction de consommation chez KEYNES). Toute augmentation de la masse

Yohan Rimaud - 2 - 17/04/2017

monétaire induit de l’inflation. Est dénoncée la responsabilité de l’Etat qui dépense toujours

plus sans augmenter la pression fiscale.

En déficit, l’inflation allège le poids de la dette. Les individus ont la capacité d’intégrer dans

leurs calculs économiques l’évolution des prix. A court terme les individus pensent être

trompés ; à long terme ils réagissent.

Pour FRIEDMAN la banque centrale doit être indépendante du politique, garantir la stabilité

des prix, et la croissance monétaire doit être indexée sur la croissance du PIB à long terme.

Pour les keynésiens, l’inflation par la demande s’explique par une insuffisance de l’offre à

cause des facteurs de production employés au maximum dans un secteur ou difficilement

mobilisables à court terme. L’inflation est le symptôme d’une demande importante, elle peut

favoriser l’investissement, elle incite la consommation et décourage l’épargne (fuite).

L’inflation est donc positive.

On estime aujourd’hui à entre 2 et 3 % le niveau d’inflation supportable.

Les conséquences de l’inflation sur les différents acteurs

Les emprunteurs sont favorisés par l’inflation à condition que les taux d’intérêts soient

fermes. Les épargnants subissent l’érosion de leur patrimoine. Il y a ainsi un transfert de

pouvoir d’achat des créditeurs vers les débiteurs.

Les entreprises sont favorisées dans leurs investissements : l’emprunt est à bas prix, les ventes

se font à prix élevés (on parle « d’effet levier »).

En 1947, John HICKS a distingué l’économie d’endettement (rôle des banques en termes

d’intermédiation) et l’économie des marchés financiers (épargne préexistante inchangée).

Le rôle des anticipations en matière d’inflation

Les anticipations ont un rôle important, confirmant le postulat selon lequel la création

monétaire la création monétaire n’aurait aucun effet sur le monde réel de la production ; en

effet les agents ont conscience que la hausse de leur salaire nominal ne signifie pas pour

autant la hausse de leur salaire réel, et s’abstiennent de produire ou travailler d’avantage. Ils

augmentent plutôt le prix des biens et services qu’ils offrent afin de maintenir leur pouvoir

d’achat malgré la hausse des prix anticipée.

L’ « illusion nominale » et ses conséquences matière de calculs

économiques

L’ « illusion nominale » est une confusion entre l’augmentation des prix constatée

(notamment des salaires) et l’augmentation du pouvoir d’achat réel.

Pour les keynésiens, cette illusion peut aider peut aider à une relance par l’augmentation de la

consommation.

Pour les monétaristes, elle est affaiblie par les anticipations inflationnistes (il s’agit donc

d’une illusion temporaire).

Pour les théoriciens d’anticipation rationnelle, elle n’a aucune influence car l’anticipation se

fait immédiatement.

Taux d’intérêts et inflation

Il convient de distinguer entre taux d’intérêts nominaux (constatés à un moment t) et taux

d’intérêts réels (prenant en considération l’inflation).

D’après Irving FISCHER : tir = tin - (hausse des prix).

Yohan Rimaud - 3 - 17/04/2017

L’inflation provoque une diminution des taux d’intérêts réels à condition que les banques

n’ajustent pas à la hausse les taux d’intérêts nominaux.

Le « dilemme français »

Le « dilemme français » est une expression datant des années 1980.

L’inflation forte peut nuire à terme aux entreprises via la dévaluation ; il s’agit alors

d’inflation importée.

On pouvait tolérer l’inflation parce qu’elle permettait des ajustements moins douloureux mais

nécessitait de ralentir la demande intérieure. On pouvait préférer la rigueur et le

rétablissement d’un Franc fort.

La lutte contre l’inflation a amené à restreindre le crédit (en 1975) et à modifier le mode de

négociation salariale (avec une modération des salaires très forte, une montée du chômage ; en

l’occurrence le chômage a peut-être causé la modération salariale).

[ 2 ] Monnaie et activité

Pour KEYNES, il existe une demande de monnaie pour spéculation. Cette demande peut être

reliée aux cours. Or ceux-ci dépendent des taux d’intérêts. La détention de motifs de

spéculation est une fonction décroissante du taux.

Dans l’économie, il y a des taux d’intérêts directeurs à court terme fixés par les banques

centrales. Il existe des taux d’intérêts à plus long terme sur lesquels les banques centrales

n’interviennent pas. Les liens dépendent des anticipations : une inflation future élevée

détermine des taux d’intérêts élevés.

Les formes de la théorie quantitative

Voir BODIN, FISCHER, Cambridge, les monétaristes.

Le rôle de la monnaie dans la théorie keynésienne

Il n’y a pas ici de dichotomie entre la sphère réelle et la sphère monétaire.

On peut remédier sous-emploi par l’émission monétaire, qui diminue les taux d’intérêts et

favorise les investissements.

KEYNES admet les 3 fonctions de la monnaie chères à ARISTOTE : réserves de valeur,

étalon de mesure et moyen de transaction. En outre elle peut être désirée pour elle-même, afin

d’effectuer des anticipations dans une économie incertaine : la monnaie va remplir une

fonction particulière, celle de se prémunir pour une part contre l’incertitude. En effet, elle a

une liquidité forte (en tant que moyen de paiement : KEYNES parle de « préférence pour la

liquidité » puisqu’on peut se prémunir contre une baisse des prix anticipés). De plus les agents

raisonnent en termes nominaux car il est nécessaire d’avoir des certitudes notamment

concernant le salaire nominal. C’est en monnaie que se font les anticipations sur le futur.

La préférence pour la liquidité a un coût : le taux d’intérêt. Celui-ci est donc monétaire : la

variable importante va être la quantité de monnaie en circulation.

Trois motifs de demande de monnaie peuvent être distingués :

- un motif de précaution : garder une certaine quantité pour faire face à une dépense imprévue

- un motif de transaction : effectuer les paiements liés à la consommation

- un motif de spéculation : acheter des titres.

Les 2 premiers motifs dépendent des besoins donc du revenu, le 3ème des taux d’intérêts.

Yohan Rimaud - 4 - 17/04/2017

On rappellera que chez KEYNES, le revenu se répartit entre consommation et épargne, le

facteur déterminant étant la propension à consommer. L’épargne se répartit elle-même entre

détention de monnaie et de titres, le facteur déterminant étant les taux d’intérêts.

Les grands principes du modèle IS-LM

Le modèle IS-LM est une représentation proposée par John HICKS en 1937 des mécanismes

keynésiens : le modèle a été jugé par KEYNES globalement conforme à sa pensée.

Le modèle IS-LM reprend les hypothèses keynésiennes : rigidité des prix, ajustement par les

quantités et intégration de la monnaie dans l’équilibre économique.

Il utilise 2 courbes : la courbe IS (investment, saving) représente le bloc réel, la courbe LM

(liquidity, money) le bloc monétaire.

Le principe est la combinaison de 2 égalités : Y = C + I (provenance)

Y = C + S

Ce qui revient à dire que C + I = C + S ou que I = S. La condition d’équilibre est donc que

l’investissement soit égal à l’épargne.

L’investissement est une fonction décroissante du taux d’intérêt, l’épargne est une fonction du

revenu : les déterminants ne sont pas les mêmes. Une certaine valeur du taux d’intérêt et du

revenu détermine un équilibre.

La courbe IS, c’est l’ensemble des couples (i,Y) tels qu’il y a équilibre sur le marché des

biens et services. Elle est décroissante.

Dans le bloc monétaire sont intégrés les motifs de précaution, transaction et spéculation.

On demandera d’autant plus de monnaie que le revenu est élevé, d’autant moins que le taux

d’intérêt est élevé.

Il existe un couple (i*,Y*) pour qu’il y ait équilibre de l’économie. La question est ensuite

d’agir sur IS ou LM pour déplacer le couple afin d’atteindre le plein-emploi.

L’ouverture des économies est intégrée dans le modèle IS-LM-BP.

Yohan Rimaud - 5 - 17/04/2017

Il existe 3 cas possibles :

- IS1 : le taux d’intérêt ne diminue plus car il est très faible : c’est la zone keynésienne extrême

où la politique monétaire n’a aucun effet à cause de la « trappe à monnaie »

- IS2 : c’est la zone keynésienne classique : la politique monétaire est efficace

- IS3 : la politique monétaire est la plus efficace.

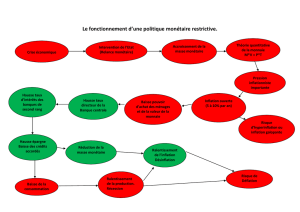

L’efficacité des politiques monétaires

La banque centrale peut agir sur la demande de crédit en jouant sur le taux d’intérêt.

Globalement, c’est la courbe LM qui est déplacée : une expansion monétaire correspond à un

déplacement vers la droite.

Un taux d’intérêt plus bas a un effet multiplicateur.

La politique expansionniste s’est révélée efficace.

Les fondements des courants monétariste et nouveau-classique et leur

lecture de la courbe de PHILLIPS

La courbe de PHILLIPS représente la relation entre le taux de chômage et le taux de variation

des salaires nominaux : cette variation est décroissante et non linéaire.

Les keynésiens ont remplacé cette relation par une relation inflation-chômage.

6

6

7

7

8

8

9

9

10

10

11

11

12

12

13

13

14

14

15

15

16

16

17

17

18

18

19

19

20

20

21

21

22

22

23

23

24

24

25

25

26

26

27

27

1

/

27

100%