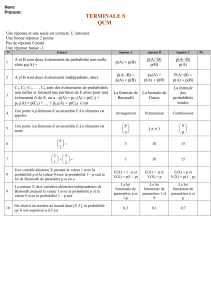

Reconnaissance des lois usuelles

RECONNAISSANCE DES LOIS USUELLES

RETOUR AU MENU VARIABLES DISCRETES

RETOUR ACCUEIL

Remarque méthodologique importante pour les problèmes de concours

De nombreux problèmes de probabilités font appel à la reconnaissance des lois discrètes du

programme.

Pour traiter ce type de question il convient, même si l’énoncé ne le demande pas

explicitement de commencer par considérer que l’événement dont on connaît la

probabilité (notée en général p) est un succès. En conséquence de quoi l’événement

contraire constitue un échec. Le succès sera noté [Xi=1] et l’échec sera noté [Xi=0]

On a ainsi défini une variable aléatoire Xi de Bernoulli qui peut prendre 2 valeurs : 0 et 1. On

note alors Xi(

) =

1;0

; P[Xi=1] = p et P[Xi=0]=1-p=q

a. Propriétés de la loi de Bernoulli.

On peut s’assurer que Xi définit bien une variable discrète en vérifiant que

)( ][

Xk kXiP

=1

En effet :

)( ][

Xk kXiP

= P[Xi=0]+P[Xi=1]=p+1-p = 1

E(Xi) =

)( ][

Xk kXikP

= 0.P[Xi=0]+1.P[Xi=1]=0p+1.p=p

E(Xi2)=

)(

2][

Xk kXiPk

=02.P[Xi=0]+12.P[Xi=1]=0p+12.p=p

V(Xi)= E(Xi2)-[ E(Xi)]2= p-p2==p(1-p).

La loi de Bernoulli peut donc se définir à l’aide d’un seul paramètre, p, qui est son espérance

mathématique. La variance s’obtient directement à partir de p. On écrit alors :

X

B(p)

pqXV

pXE

pqXP

pXP

X

)(

)(

1]0[

]1[

1;0)(

b) Reconnaissance d’une loi binômiale

On considère la succession de n essais identiques et indépendants les uns des autres d’une

même épreuve ayant deux issues possibles : le succès avec la probabilité p et l’échec avec la

probabilité q=1-p. On définit une variable X égale au nombre de succès obtenus à l’issue de

ces n épreuves.

X correspond à la succession (ou à la somme) de n épreuves de Bernoulli (puisque leur

caractéristique est d’avoir deux issues possibles : le succès et l’échec) identiques et

indépendantes.

On dit alors que X suit une loi Binômiale définie par 2 paramètres : n = nombre d’épreuves

(de Bernoulli identiques et indépendantes) et p = probabilité du succès pour chaque épreuve.

On écrit :

X

B(n, p)

npqXV

npXE

qpCkXP

xNnX

knkk

n

)(

)(

][

;0)(

Cette situation se rencontre lorsque l’on considère une urne comportant des boules de deux

couleurs différentes et que l’on cherche la loi du nombre de boules d ‘une des deux couleurs à

l’ssue de n tirages (d’une boule à chaque tirage) avec remise.

En effet, les tirages sont identiques si l’on suppose que l’on prélève toujours une boule à

chaque tirage. En outre, si la boule tirée est systématiquement remise dans l’urne, la

composition de l’urne est constante. Dès lors, la probabilité d’obtenir une boule d’une couleur

donnée est la même à chaque tirage. Les tirages sont donc indépendants les uns des autres.

Remarque importante :

Le modèle d’urne qui vient d’être donné est seulement une illustration. Les énoncés de

problèmes de concours ne portent pas toujours sur des tirages de boules dans des urnes. Il

convient donc de retenir que la loi Binômiale est d’abord la loi du nombre de succès dans une

succession de n épreuves identiques et indépendantes.

Exemple

On considère une entreprise de service après-vente (SAV) qui intervient avec retard avec une

probabilité égale à 0,25. Un client a appelé à 8 dates différentes.

1°) Préciser la loi de X, son espérance et sa variance

2°) Calculer la probabilité que ce client soit victime d’au moins un retard

3°) Calculer la probabilité que ce client soit victime d’au moins 4 retards sachant qu’il en a

subi au moins un.

(ESCAE 82 M2)

1°) Appelons succès l’événement dont on connaît la probabilité, à savoir « intervenir avec

retard » et notons le [Xi=1] ; appelons échec l’événement contraire (à savoir « intervenir

ponctuellement ») et notons le [Xi=0]. On a :

P[Xi=1]=0,25 et P[Xi=0]=1-0,25=0,75, avec Xi(

) =

1;0

A l’issue de chaque appel, la probabilité d’intervention avec retard est la même. Les appels

peuvent donc être supposés indépendants les uns des autres. Par conséquent, X est la

succession de 8 épreuves de Bernoulli identiques et indépendantes. X suit donc une loi

binômiale :

X

B(8, 0,25)

5,175,025,08)(

225,08)(

75,025,0][

8;0)(

8

xxXV

xXE

CkXP

xNX

knkk

2°) P[X

1]=P[(X=1)ou(X=2)ou…ou(X=8)]= P[(X=1)

(X=2)

…

(X=8)]

= P[X=1]+P[X=2]+…+P[X=8] . Ce calcul peut être effectué en posant successivemnt k=1,

k=2,…,k=8. Il est toutefois plus simple de remarquer que, dans la mesure où [X

1] est

l’événement contraire de [X<1] :

P[X

1]=1-P[X<1] =1-P[X=0]=1-

0800

875,025,0

C

=1-0,758 =

3°) P[X

4/X

1]=

]1[ ]14[

XP

XP

=

]1[ ]41[

XP XP

P[X

1] a été calculé à la question précédente. Il reste donc à calculer :

41[ XP

]= P[X=1]+ P[X=2]+ P[X=3]+ P[X=4]

=

1811

875,025,0

C

+

2822

875,025,0

C

+

3833

875,025,0C

4844

875,025,0

C

Conclusion : P[X

4/X

1] =

c) Reconnaissance d’une loi hypergéométrique

On effectue n tirages SANS REMISE dans une population (ou dans une urne) de taille N. On

recherche alors la loi du nombre de réalisations d’un événement dont la probabilité de

réalisation, avant que ne commencent les tirages, est égale à p.

NB : la composition de la population (ou de l’ urne) change à l’issue de chaque tirage puisque

l’individu (ou la boule) qui vient d’être tiré(e) n’est pas remis(e) dans la population (ou das

l’urne).

Soit X le nombre de succès, ou de réalisation de l’événement dont on connaît la probabilité

avant que ne commencent les tirages.

X définit une loi hypergéotrique de paramètres N, n et p :

X

H(N, n, p)

1

)(

)(

][

;min();;0max()(

NnN

npqXV

npXE

C

CC

kXP

xNNpnNqnX

n

N

kn

Nq

k

Np

Remarque importante

Cette loi de tirages sans remise est également la loi des sondages : en effet, si l’on interroge n

personnes issues d’une population globale de taille N, chaque individu est interrogé une seule

fois. En d’autres termes, il n’est pas remis dans la population initiale après avoir été sondé.

Suite de l’exemple précédent

On consière 8 clients différents. On en contacte 4.

On admet qu’un client est mécontent s’il a fait l’objet d’une intervention avec retard.

On note M le nombre de mécontents .

Donner la loi de M, son espérance et sa variance.

M correspond, dans le cadre d’un sondage, au tirage de 4 clients dans une population de 8

clients sans remise : on peut en effet penser que la personne chargée de l’étude de satisfaction

n’interroge chaque client qu’une seule fois.

En outre, avant de commencer les tirages des individus, on sait que la probabilité

d’intervention avec retard, donc de mécontentement est de 0,25, doù :

X

H(8, 4, 0,25)

18 48

75,025,04)(

25,04)(

][

25,08;4min();75,084;0max()(

4

8

475,0825,08

xxXV

xXE

C

CC

kXP

xNxxX

k

x

kx

7

4

75,0)(

1)(

][

2;0)(

4

8

4

62

XV

XE

C

CC

kXP

xNX

kk

d) Reconnaissance d’une loi géométrique

On effectue n épreuves (de Bernoulli) identiques et indépendantes dont la probabilité de

succès est p pour chacune d’elles. La probabilité de l’échec pour chacune d’elles est notée

q=1-p.

On appelle X le rang du 1er succès. Dès lors :

P[X=k] signifie « probabilité que le 1er succès soit obtenu à l’issue de la k-ième épreuve. En

d’autres termes, les k-1 premières épreuves se sont soldées par des échecs et la k-ième par un

succès.

Soit Ei= « obtention d’un échec à l’issue de la i-ième épreuve » et Si =« obtention d’un succès

à l’issue de la i-ième épreuve ». Dès lors :

P[X=k] = P(E1

E2

...

Ek-1

Sk).

Comme les épreuves sont supposées indépendantes :

P[X=k] = P(E1)P(E2)...P(Ek-1)P(Sk) =

foisk

qqq

1

.....

p = qk-1p.

NB : il faut au moins réaliser une épreuve pour obtenir un succès. En outre, il faudra

éventuellement un nombre infini d’épreuves pour obtenir un succès, d’où :

X

)(pG

2

1

/)(

/1)(

][

;1)(

pqXV

pXE

pqkXP

X

k

Suite de l’exemple précédent

Soit Y la loi du rang du 1er retard. Préciser la loi de Y , son espérance et sa variance

6

6

1

/

6

100%